Что пишут в блогах

- Как правильно задавать вопросы к требованиям?

- Мои 12 недель в году. Часть 26 (Лицензия на ИП и 3-я книжка!)

- Как войти в новый проект: взаимоотношения с командой и пользователями, тестовая лаборатория

- Баги - отдельные задачи или комментарии?

- Митап от Тинькофф “Техтолк инженеров по тестированию” 20 марта 2024

- Опрос: поделитесь мнением про техдолг

- Если вы стали QA-менеджером

- Книга "Баг-трекинг: локализация и оформление дефектов" уже в продаже!

- Топ 30 вопросов на собеседовании на тестировщика ПО (Junior QA)

- Идеальный час

Что пишут в блогах (EN)

- Navigating the Future of Software Development: Embracing Collaborative modelling

- In the era of Accessibility Testing

- What If You Are Not Around?

- Five for Friday – April 5, 2024

- The Possible and Impossible: Mathematical Thinking for Planning

- Looking back at Agile Testing, 15 years on

- Does Test Automation Necessarily Make Our Jobs Easier?

- 10 Bad Reasons Why Companies Don’t Hire Testers

- Judging Developers by GitHub Contributions

- Five for Friday – March 29, 2024

Онлайн-тренинги

-

Автоматизация тестов для REST API при помощи PostmanНачало: 25 апреля 2024

-

Школа для начинающих тестировщиковНачало: 25 апреля 2024

-

Python для начинающихНачало: 25 апреля 2024

-

Азбука ITНачало: 25 апреля 2024

-

Тестирование производительности: JMeter 5Начало: 26 апреля 2024

-

Тестирование REST APIНачало: 29 апреля 2024

-

Логи как инструмент тестировщикаНачало: 29 апреля 2024

-

Автоматизатор мобильных приложенийНачало: 1 мая 2024

-

Автоматизация тестирования REST API на PythonНачало: 1 мая 2024

-

Тестирование мобильных приложенийНачало: 1 мая 2024

-

Автоматизация тестирования REST API на JavaНачало: 1 мая 2024

-

Тестирование безопасностиНачало: 1 мая 2024

-

Инженер по тестированию программного обеспеченияНачало: 2 мая 2024

-

Техники локализации плавающих дефектовНачало: 6 мая 2024

-

Тестирование без требований: выявление и восстановление информации о продуктеНачало: 13 мая 2024

-

Английский для тестировщиковНачало: 13 мая 2024

-

Тестировщик ПО: интенсивный курс со стажировкой (ПОИНТ)Начало: 14 мая 2024

-

Тестирование юзабилити (usability)Начало: 15 мая 2024

-

Регулярные выражения в тестированииНачало: 16 мая 2024

-

Консольные утилиты Android: инструменты тестировщикаНачало: 16 мая 2024

-

SQL: Инструменты тестировщикаНачало: 16 мая 2024

-

Docker: инструменты тестировщикаНачало: 16 мая 2024

-

Git: инструменты тестировщикаНачало: 16 мая 2024

-

Bash: инструменты тестировщикаНачало: 16 мая 2024

-

Charles Proxy как инструмент тестировщикаНачало: 16 мая 2024

-

Chrome DevTools: Инструменты тестировщикаНачало: 16 мая 2024

-

Тестирование веб-приложений 2.0Начало: 17 мая 2024

-

Организация автоматизированного тестированияНачало: 17 мая 2024

-

Школа тест-менеджеров v. 2.0Начало: 22 мая 2024

-

Создание и управление командой тестированияНачало: 23 мая 2024

-

Автоматизация функционального тестированияНачало: 24 мая 2024

-

SQL для тестировщиковНачало: 27 мая 2024

-

Школа Тест-АналитикаНачало: 29 мая 2024

-

Selenium IDE 3: стартовый уровеньНачало: 31 мая 2024

-

Программирование на Java для тестировщиковНачало: 31 мая 2024

-

Погружение в тестирование. Jedi pointНачало: 3 июня 2024

-

Программирование на C# для тестировщиковНачало: 7 июня 2024

-

Аудит и оптимизация QA-процессовНачало: 7 июня 2024

-

Комплексная система подготовки тестировщиков по программе ISTQB FLНачало: 17 июня 2024

-

Selenium WebDriver: полное руководствоНачало: 28 июня 2024

| Автоматизация нагрузочного тестирования банковского ПО для терминалов |

| 23.08.2017 00:00 |

|

Автор: Команда нагрузочного тестирования компании "Инфосистемы Джет" Оригинальная публикация: habrahabr.ru/company/jetinfosystems/blog/329014/?utm_source=software-testing В этом посте речь пойдет о тестировании серверного ПО, которое обслуживает огромную сеть банковских терминалов в России и за рубежом. Название банка мы раскрыть не можем, некоторые строчки конфигов скрыты. Автоматизация Начнем издалека. Мы постоянно слышим одно и то же: “Автоматизировать нагрузочное тестирование банковского и финансового ПО невозможно! У нас слишком много взаимосвязей! Мы очень сложные!”. Этот вызов только усиливал азарт решения задачи. Нам всегда хотелось проверить сложность на конкретном примере.

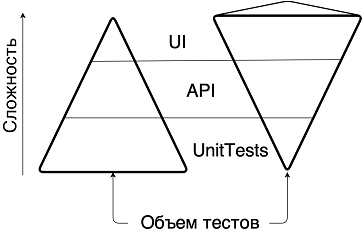

Вместо того, чтобы заниматься нагрузочным тестированием ПО на уровне взаимодействий систем, в секторе банковского ПО традиционно все тестируют через UI, как повелось со времен неразъемных систем и приложений. На это уходит много времени и сил, что делает разработку банковского ПО медленной, некачественной и нетехнологичной. Мы в компании “Инфосистемы Джет” были избавлены от этих стереотипов — разработчики сами писали юнит-тесты на свой код, функциональные тестировщики прекрасно программировали UI-тесты через Selenium+Cucumber. Осталось только встроить в процесс дополнительную стадию нагрузочного тестирования. Проектирование инфраструктуры В самом начале мы решили отказаться от взаимосвязей, которые усложняют и размывают ответ на вопрос, насколько производительный и надежный код мы разрабатываем. Например, авторизация и выдача токенов на проведение операций — это функциональность сторонней системы, исследовать производительность которой в рамках задачи было бы избыточно. Помимо этого мы сразу отказались от интеграции с несколькими back-office системами, сделав заглушку, отвечающую нашей системе с определенной задержкой (все мы знаем, как опасно тестировать систему на сверхбыстрых моках). После проектирования и осмотра оставшейся инфраструктуры стало примерно понятно, как будет выстроен процесс, какие бенефиты будут получены, и нужно было приступать к созданию самого процесса НТ.

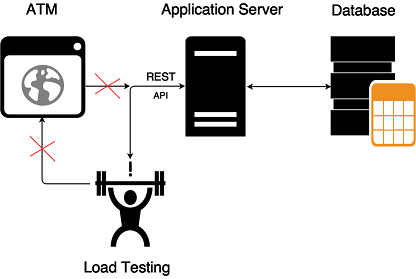

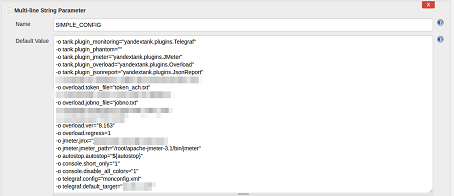

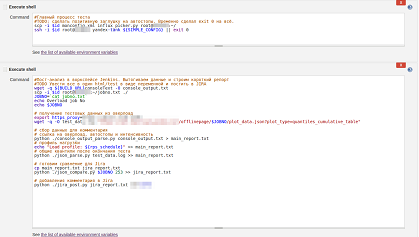

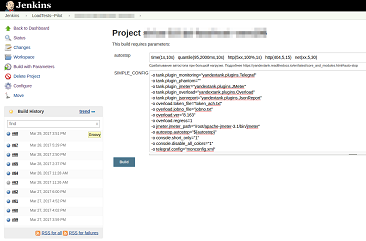

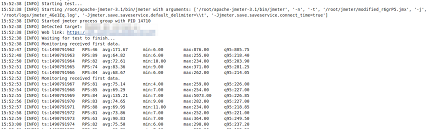

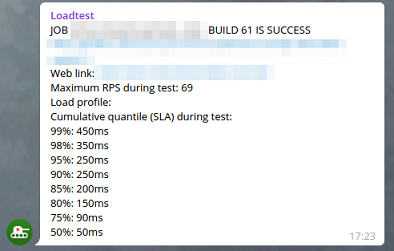

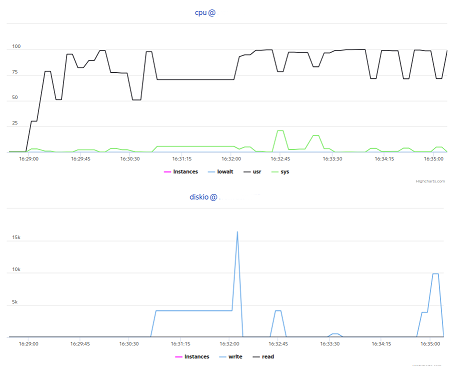

CI/CD процесс и программное обеспечение Код ПО выкладывается во внутреннем git-репозитории (GitLab). После коммита по специальному триггеру Jenkins вытаскивает код на сборочную машину и пытается собрать релиз с прогоном всех заведенных Unit-тестов. После успешной сборки с помощью скриптов собранный билд инсталлируется в два тестовых окружения ‒ НТ и ФТ ‒ и делает рестарт тестинга. После подъема бэкенда Jenkins прогоняет друг за другом ФТ, UI и ИФТ-тесты. Нагрузочное тестирование запускается отдельной задачей, но про это стоит рассказать отдельно. Самое интересное После того как билд попадает на нагрузочный стенд, посредством скриптов в Jenkins запускается специальная задача для нагрузочного тестирования. Задача настроена классическим способом, через shell-скриптинг и параметризацию. Кликните на картинку, чтобы увеличить изображение Так выглядит конфиг Yandex.Tank: Кликните на картинку, чтобы увеличить изображение А так выглядит пример shell-script запуска всего процесса НТ: Кликните на картинку, чтобы увеличить изображение Как видите, все настройки достаточно примитивны. При автоматическом запуске джоба дефолтные параметры применяются автоматически, при ручном же запуске вы можете конфигурировать стрелялку параметрами Jenkins, не разбираясь в документации и не копаясь на Linux-машинке и перебирая необходимые конфиги. Кликните на картинку, чтобы увеличить изображение После запуска теста вы получаете ссылку в Console View Jenkins и Telegram, перейдя по которой можно наблюдать нагрузочный тест в реальном времени: Кликните на картинку, чтобы увеличить изображение Кликните на картинку, чтобы увеличить изображение Если результаты теста вышли за пределы SLA, то тест автоматически останавливается и вы получаете репорт в Telegram, почту и JIRA о проблемах с релизом. Если же результат хороший, то после репорта релиз получает статус SUCCESS и готов для деплоя на нагруженную среду, в продакшн.

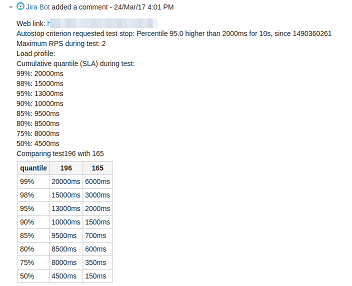

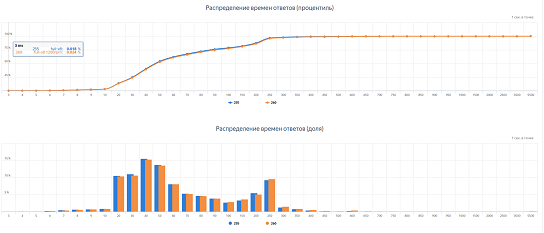

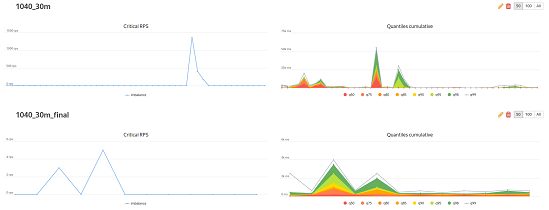

А так бот репортит результаты в JIRA: Кликните на картинку, чтобы увеличить изображение В качестве корпоративной “плюшки” от Яндекса мы получили доступ к сравнению тестов: Кликните на картинку, чтобы увеличить изображение и доступ к построению регрессионных отчетов по KPI-метрикам: Кликните на картинку, чтобы увеличить изображение Проблемы и решения

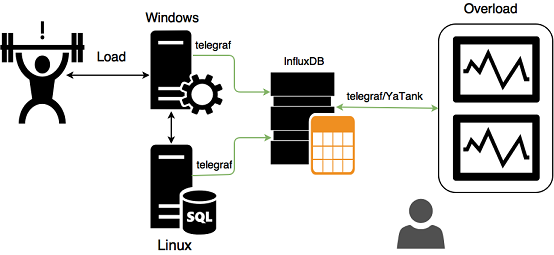

В данном случае, все метрики с серверов и load-генераторов пишутся в InfluxDB локальными агентами telegraf, а мониторинг Яндекс.Танка уже извлекает данные из InfluxDB простейшим скриптом и пушит данные в Overload. Такой подход позволяет отказаться от поддержки всего зоопарка операционных систем со стороны Яндекс.Танка и избежать необходимости коннекта “от одного ко всем”. from inflow import Client import sys try: connect = Client(sys.argv[1]) try: query_string = "SELECT LAST(" + sys.argv[4] + ") FROM " + sys.argv[3] + " WHERE host='" + sys.argv[2] + "';" result = connect.query(query_string) print (result[0]["values"][0]["last"]) except: print ("Bad request or something wrong with DB. See logs on " + sys.argv[1] + " for details.") except ValueError: print("Something wrong with parameters. " "Usage: python ./influx_picker <http://db_host:port/dbname> <target_host> <group> <metric>") except IndexError: print("Usage: python ./influx_picker <http://db_host:port/dbname> <target_host> <group> <metric>")

<Monitoring> <Host address="localhost" interval="5"> <Custom diff="0" measure="call" label="cpu_sys">python influx_picker.py http://<INFLUXDB_IP>:8086/target_host target_host cpu usage_system</Custom> <Custom diff="0" measure="call" label="cpu_usr">python influx_picker.py http://<INFLUXDB_IP>:8086/target_host target_host cpu usage_user</Custom> <Custom diff="0" measure="call" label="cpu_iowait">python influx_picker.py http://<INFLUXDB_IP>:8086/target_host target_host cpu usage_iowait</Custom> <Custom diff="0" measure="call" label="mem_free_perc">python influx_picker.py http://<INFLUXDB_IP>:8086/target_host target_host mem available_percent</Custom> <Custom diff="0" measure="call" label="mem_used_perc">python influx_picker.py http://<INFLUXDB_IP>:8086/target_host target_host mem used_percent</Custom> <Custom diff="0" measure="call" label="diskio_read">python influx_picker.py http://<INFLUXDB_IP>:8086/target_host target_host diskio read_bytes</Custom> <Custom diff="0" measure="call" label="diskio_write">python influx_picker.py http://<INFLUXDB_IP>:8086/target_host target_host diskio write_bytes</Custom> </Host> </Monitoring>

Кликните на картинку, чтобы увеличить изображение Репортинг. Мы использовали два вида репортинга результатов. Заключение Как можно заметить, данная задача не из разряда Rocket Science, и вы могли читать подобные статьи здесь, здесь и даже смотреть видео здесь. Под капотом лежат обычные скрипты и сервисы ‒ мы всего лишь хотели продемонстрировать, что на самом деле к эре “Devops” и повальной автоматизации финансовый сектор готов уже давно, просто нужно иметь смелость и политическую волю внедрять современные и быстрые процессы.

|